Chińska aplikacja pozwala zostać DiCaprio w 8 sekund. Eksperci ostrzegają przed ZAO

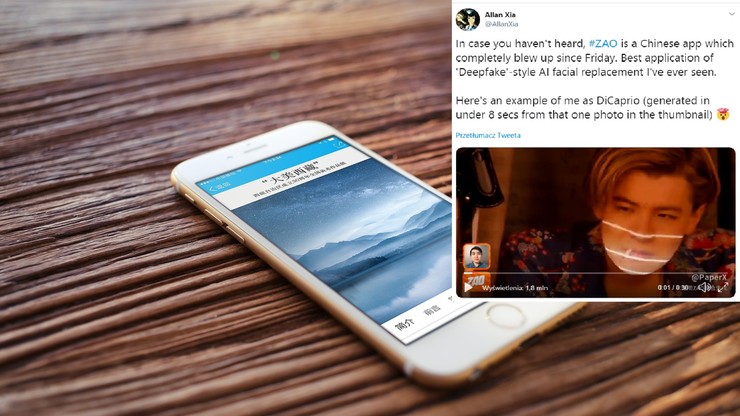

Chińska aplikacja z dnia na dzień stała się bardzo popularna. ZAO umożliwia użytkownikom przesyłanie zdjęć, z których twarze zostają "wstawione" do fragmentów filmów i seriali. Eksperci ostrzegają przed falą "deepfake'ów" oraz możliwością nadużyć. Zwracają także uwagę na kwestię prywatności, podobnie jak w przypadku aplikacji do "postarzania" twarzy FaceApp.

ZAO została zaprezentowana w Chinach z końcem sierpnia. Już w ciągu weekendu stała się najczęściej pobieraną aplikacją. Zasada jej działania wygląda prosto, jednak wykorzystano przy niej potężny silnik obliczeniowy. Użytkownicy udostępniają swoje selfie, w których mrugają i poruszają ustami, natomiast aplikacja używa ich do przekształcenia obrazu w taki sposób, by w jak najwyższym stopniu odpowiadały filmowym pierwowzorom.

In case you haven't heard, #ZAO is a Chinese app which completely blew up since Friday. Best application of 'Deepfake'-style AI facial replacement I've ever seen.

— Allan Xia (@AllanXia) September 1, 2019

Here's an example of me as DiCaprio (generated in under 8 secs from that one photo in the thumbnail) 🤯 pic.twitter.com/1RpnJJ3wgT

Kwestia prywatności

Podobnie jak w przypadku kontrowersyjnej FaceApp, zarówno polityka prywatności ZAO, jak i technologia wzbudzają obawy. Ma to związek z koniecznością zaakceptowania warunków korzystania z aplikacji. Umożliwiają one twórcom użycie zdjęć do celów przetwarzania i marketingu, jednak w rzeczywistości nie mamy pewności, gdzie i na jakich zasadach posłużą się oni naszym wizerunkiem - ostrzega "Forbes".

Okazuje się, że FaceApp i ZAO mają sporo wspólnego. Pierwsza z nich ze swoją luźną polityką prywatności, wiązała się z widocznym ryzykiem "wysyłania" danych do Rosji. Choć, jak twierdzi "Forbes", informacje te miały być przesadzone, to w kwestiach bezpieczeństwa głos zabrało nawet polskie Ministerstwo Cyfryzacji.

Chinese viral deepfakes app #ZAO Clip of myself as Sheldon generated in a few seconds from a single picture. pic.twitter.com/JI7MqWUDu6

— Matthew Brennan (@mbrennanchina) September 1, 2019

Głosy krytyczne

Także w przypadku ZAO pojawiły się głosy krytyczne. Eksperci zwracają uwagę na możliwość generowania tzw. "deepfake'ów", czyli fotomontaży wideo wygenerowanych dzięki sieciom neuronowym.

Firma odpowiedzialna za ZAO była zmuszona wydać oświadczenie dotyczące polityki prywatności aplikacji, która miała "bezpłatne, nieodwołalne, stałe, zbywalne i licencjonowane" prawa do wszystkich treści generowanych przez użytkowników.

"Zdajemy sobie sprawę z obaw dotyczących prywatności. Przyjęliśmy do wiadomości przesłane uwagi i zajmiemy się sprawami, których dotychczas nie braliśmy pod uwagę, co może potrwać" - wskazano w oświadczeniu.

Dezinformacja

Twórcy zobowiązali się także ograniczyć wykorzystanie niektórych scen, np. strzałów w głowę. Zadeklarowano także trwałe skasowanie z serwerów treści, które użytkownicy zamieścili, ale później zdecydowali się usunąć.

Jak informuje theguardian.com, przeciwnicy aplikacji twierdzą, że technologii tej można używać do tworzenia fałszywych filmów wideo, aby manipulować wyborami, zniesławić kogoś lub potencjalnie wywołać niepokój wśród społeczeństwa poprzez rozpowszechnianie dezinformacji na dużą skalę.

Czytaj więcej